Designing Respectful Tech:您与技术的关系是什么?

你以前去过那里。你以为你可以相信一个有秘密的人。你以为这样很安全,但后来发现他们对每个人都喋喋不休。或者,也许他们没有分享它,但他们使用它的方式感觉很操纵。你付出的比得到的多,感觉不公平。但是现在它已经存在了,你还有控制权吗?

好的。现在想象那个人是你的超市。

或者你的医生。

或者你的老板。

你与技术有私人关系吗?

根据Me2B 联盟的研究,人们确实觉得他们与技术有关系。这是情绪化的。它体现了。而且非常个人化。

它有多个人化?想想如果你在咖啡馆下订单,他们已经知道你的名字、电子邮件、性别、实际位置、阅读的内容、约会的对象,以及也许你已经知道会是什么样子想分手。

我们不赞成人际关系中的八卦行为。那么我们为什么要接受技术呢?当然,我们会获得一些时间和便利,但在很多方面它会让人感到被锁定和不平等。

Me2B 关系模型

在 Me2B 联盟,我们正在研究数字关系以回答诸如“人们与技术有关系吗?”之类的问题。(他们觉得他们确实如此)。“这种关系是什么感觉?” (情况很复杂)。以及“人们在探索、进入和解散这些关系时是否理解他们所做的承诺?” (他们真的没有)。

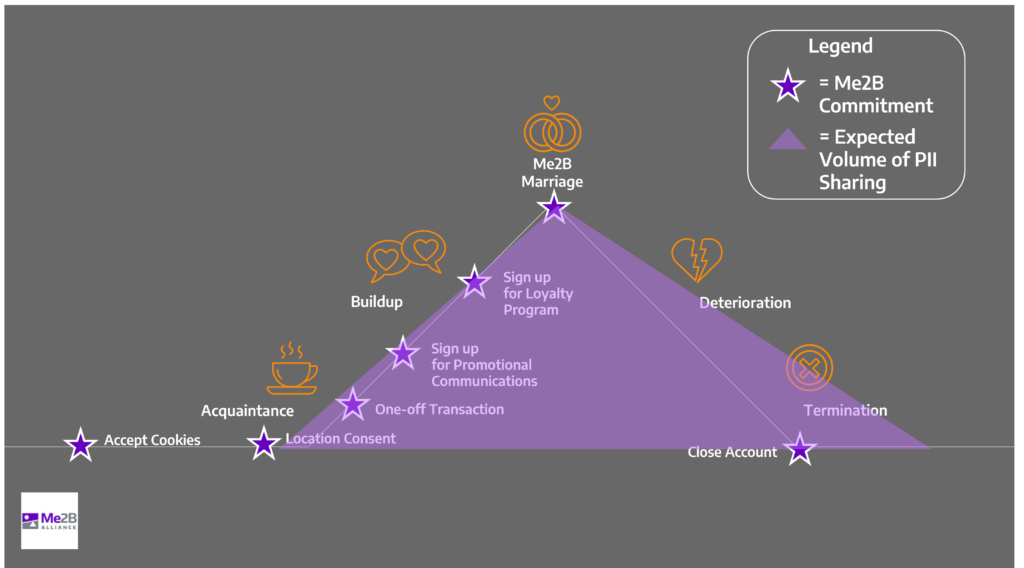

将我们与技术打交道视为一种关系可能看起来很愚蠢或尴尬,但就像混乱的人际关系一样,也有相似之处。采用数字技术的 Me2BA 承诺弧类似于德国心理学家 George Levenger 的 ABCDE 关系模型1,如下图橙色图标所示。与人际关系一样,我们也通过数字应用程序经历发现、承诺和分手的状态。

我们对技术关系的假设与我们对人类关系的假设相似。我们假设当我们第一次见到某人时,会有一张白纸,但这并不总是正确的。会议前可能会有关于你的八卦。其他人可能在 LinkedIn 上查找了您。使用任何技术,关于您的信息可能已经为人所知,并且在您注册帐户之前就开始共享这些数据。

看不见的平行数据宇宙

今天的新闻经常报道数字媒体操纵、黑暗模式和个人数据映射造成的个人和社会伤害的故事。去年,Facebook举报人Frances Hauser 揭露了该平台如何宣传他们从自己的研究中得知的内容会导致少女抑郁和自残。他们知道这一点,因为他们知道少女点击、发布和分享的内容。

技术支持在关系弧的每个点共享数据,包括在您停止使用它之后。令人担忧的是,即使是我们更信任的数字关系也可能不安全。Me2B 联盟发现了 K-12 软件中的隐私侵犯行为,并描述了当学校忘记更新它们时 ,废弃的网站域如何将儿童和家庭置于危险之中。

您(和您的孩子)使用的大多数技术都与第三方数据经纪人以及与他们共享您的数据的其他人有关系。您使用的每个网站或移动应用程序上的每个隐私政策、cookie 同意和使用条款文件都定义了一种法律关系,无论您是选择加入还是被某些其他流程锁定。这意味着从您访问应用程序或网站的那一刻起,您就与这些实体中的每一个都存在法律关系,并且在大多数情况下,这是您发起并同意的关系。

我们数字体验的所有细节都漂浮在那里,除非我们有机构来设置如何使用或共享这些数据,以及何时应该删除这些数据,否则它们将一直存在。Me2B 联盟制定了尊重技术关系的参与规则和概述违规类型的数字危害词典,例如:

- 在用户不知情或不同意的情况下收集信息;

- 粘附合同,用户在使用内容时被迫(通常是隐含地)同意使用条款;

- 个人身份信息的丢失或滥用;和

- 描述技术政策的不明确或不透明的信息,甚至是他们正在获得的Me2B Deal 。

尊重的技术关系首先要尽量减少收集的数据量。数据最小化可减少敏感数据落入坏人之手的有害影响。

其次,我们应该赋予人们代理权和控制权。个人对个人数据的控制是当地和国际隐私法的关键部分,例如欧洲的 GDPR,以及加利福尼亚、科罗拉多和弗吉尼亚的类似法律,这些法律赋予消费者同意数据收集的权利,知道他们的哪些数据被收集,以及请求查看收集的数据、更正数据或永久删除数据。

安全和尊重设计的三大法则

在他的短篇小说《我,机器人》中,艾萨克·阿西莫夫介绍了著名的“机器人三定律”,这是一个避免机器活动有害后果的道德框架。今天,IA、程序员和其他数字创造者制造了本质上是帮助用户工作和共享信息的机器人。这项活动的大部分内容是看不见的,这实际上是我们数字技术用户喜欢的方式。

但是风险呢?作为这些机器的设计者,重要的是要考虑我们投入世界的工作的后果。我对阿西莫夫的机器人定律提出了以下推论:

- 第一定律:数字创作者不得伤害人类,或因不作为而让人类受到伤害。

- 第二定律:数字创作者必须服从其他设计师、客户、产品经理等的命令,除非这些命令与第一定律相冲突。

- 第三定律:数字创作者必须保护自己的存在,只要这种保护不与第一或第二定律相冲突。1

Mike Monteiro 在他 2014 年在 An Event Apart 上关于设计师如何毁灭世界的著名演讲中大量讨论了第二和第三定律。虽然我们从我们工作的利益相关者(客户、营销人员和我们为其设计的股东)那里接受命令,但我们有同等和更大的责任来理解和减轻具有负面影响的设计决策。

安全和尊重技术规范

Me2B 联盟正在制定安全且设计良好的数字技术规范——无害的技术。这些产品完整性测试由 UX 专家执行,并应用于一个人进入的每个承诺阶段。这些阶段包括首次打开、位置感知、cookie 同意、促销和忠诚度承诺、帐户创建以及关系的终止。

Abby Covert 的IA 原则——尤其是可查找、可访问、清晰、可通信和可控制——是非常合适的测试,可确保使用数字技术的人对他们委托给这些产品的数据拥有代理权和控制权:

Findable:管理技术关系的法律文件是否容易找到?当我认为我的数据不正确或被不当使用时,支持服务怎么办?我可以找到删除帐户或删除数据的方法吗?

可访问性:人类和机器阅读器和辅助设备是否易于访问这些资源?它们是否隐藏在某些“数据付费墙”之后,例如需要更改承诺状态(即数据收费)才能访问的流程?

清晰:普通用户能否阅读和理解说明出于什么目的需要哪些数据的信息?这些信息在相关时是否可见或可访问?

沟通性:当承诺状态发生变化时,技术是否会通知用户?例如,它是否会在需要访问我的位置或其他个人信息(如年龄、性别、医疗状况)时进行通信?它是否解释了它为什么需要我的数据以及在不再需要时如何撤销数据访问?

可控:作为用户,我有多少控制权?我可以自由地签订 Me2B 承诺,还是被迫放弃一些数据只是为了首先了解 Me2B 交易是什么?

Abby 的其他 IA 原则源于上述考虑。有用的产品是做它声称要做的事情,并清楚地传达你获得的交易。可靠的产品是尊重用户并传达其价值的产品。随着用户对数据共享的控制和对所提供服务的清晰理解,服务的真正价值是显而易见的。

随着时间的推移,用户将开始期待对承诺状态的潜在变化的通知,并且将拥有做出该选择的代理权。这些“有用的模式”——状态变化和选择加入承诺的清晰和可发现的通知——建立信任和忠诚度,为您的用户带来令人愉快的体验,或者至少是一种令人放心的体验。

我从在标准世界工作中学到的是,信息架构原则为理解数字关系和构建意义提供了一个坚实的框架。因为我们不仅仅是在设计信息空间。我们正在设计健康的关系。

来源:https://boxesandarrows.com/designing-respectful-tech-what-is-your-relationship-with-technology/